Ogólnopolska konferencja naukowa pt. „Człowiek a/i/lub maszyna”

„Cielesność wirtualna” będzie tematem III konferencji naukowej z cyklu „Człowiek a/i/lub maszyna”, która odbędzie się w Katowicach, 25 kwietnia 2019 r. Konferencję organizuje Zakład Antropologii Filozoficznej i Kognitywistyki Instytutu Filozofii WNS UŚ oraz Katedra Teologii Dogmatycznej i Duchowości WT UŚ.

Pytanie o conditio humana w epoce informatyzacji i robotyzacji jest bardzo aktualne i wymaga wieloaspektowego podejścia. Interdyscyplinarna konferencja w tym roku podejmować będzie zagadnienie cielesności, z którym wiążą się m.in. następujące pytania:

- o filozoficzne, teologiczne, kulturowe obrazy ciała i jego możliwości

- o iluzoryczność ciała (aspekt ontologiczny i epistemologiczny)

- o bezcielesną obecność w grach elektronicznych

- o pararelne ciało i jego protezy

- o podmiot i naturę doznań zmysłowych wirtualnie zapośredniczonych (realność czy symulowanie intensywoności, gwałtowności i wyrazistości doznań)

Więcej informacji na temat konferencji można uzyskać pod adresem (to także adres dla zgłoszenia uczestnictwa): mariusz.wojewoda@us.edu.pl

50. spotkanie – Ku filozofii w informatyce: przypadek dwóch projektów interdyscyplinarnych

Sagrada Família (fot. Wikimedia Commons)

Podczas czerwcowego spotkania grupy informatycznej podjęty został ważny problem badań interdyscyplinarnych związanych z informatyką oraz roli filozofii w metodologii tych badań. Prof. Tadeusz Szuba (AGH,UPJPII) wygłosił referat pt. „Ku filozofii w informatyce — przypadek dwóch projektów interdyscyplinarnych”.

Na początku prelegent przedstawił własne doświadczenia związane z interdyscypinarnoscią w informatyce. Następnie zaprezentowane i poddane dyskusji zostały dwa projekty: jeden związany z zastosowaniem gramatyk kształtów do analizy i syntezy modeli architektonicznych (przykład Sagrada Família). Drugi projekt związany był z wytworzeniem automatycznego systemu składu tekstu, który wykonywałby typowe dla humanistów i techników prace związane z redakcją i składem tekstu.

Po referacie wywiązała się długa dyskusja na temat interdyscyplinarności w informatyce oraz roli filozofii w tych badaniach.

Zaproszenie: Filozofia w informatyce IV „Filozofia wobec podstaw i zastosowań informatyki”.

Zapraszamy do udziału w IV edycji Konferencji Ogólnopolskiej pt. „Filozofia w informatyce”.

Tegoroczna Konferencja odbędzie się w dniach 23 i 24 listopada 2018 roku w Politechnice Warszawskiej (pierwszy dzień) oraz w Wojskowej Akademii Technicznej (drugi dzień).

Gościem specjalnym Konferencji będzie Profesor Raymond Turner z Wlk. Brytanii (znany filozof informatyki, autor hasła „Philosophy of Computer Science” w Stanford Encyclopedia of Philosophy).

Konferencja odbywać się będzie w języku polskim i angielskim. Planowana jest opłata konferencyjna.

Organizatorzy proszą, aby do dnia 20.06.2018 osoby już przekonane do udziału w konferencji, w tym uczestnicy jej poprzednich edycji, nadsyłać robocze zgłoszenia (najlepiej ze wstępną propozycją tytułu) na adres p.stacewicz@ans.pw.edu.pl.

Niebawem uruchomiona zostanie robocza strona konferencji, o czym niezwłocznie poinformujemy.

Nowe zajęcie filozofów: projektowanie algorytmów

Google self-driving car [by Becky Stern Attribution-ShareAlike 2.0 Generic (CC BY-SA 2.0)]

Dzięki rozwojowi technologii informatycznych filozofowie zyskali nowe zadanie: opracowanie odpowiednich algorytmów dla rozstrzygania w kwestiach o znaczeniu etycznym. To zadanie znacząco przekraczające kompetencje najlepszych inżynierów.

Można na to spojrzeć z interesującej perspektywy: najnowocześniejsza technika pomogła dostrzec wartość filozofii i to, że nie potrafimy się bez niej obejść.

Więcej na ten temat znajdziecie w interesującym artykule Philosophers are building ethical algorithms to help control self-driving cars.

Artificial intelligence experts and roboticists aren’t the only ones working on the problem of autonomous vehicles. Philosophers are also paying close attention to the development of algorithms facing the typical moral dilemmas…

49. spotkanie – Moc języków obiektowych

Drugie styczniowe spotkanie poświęcone było filozoficznej analizie języków obiektowych. Referat przedstawił dr Robert Janusz (Akademia Ignatianum).

W trakcie referatu oraz dyskusji skupiano się na wyjątkowych własnościach języków obiektowych oraz na filozoficznym znaczeniu tychże własności. Okazuje się bowiem, że języki obiektowe mają unikalne cechy predestynujące je do modelowania skomplikowanych zależności, jakie pojawiają się w filozofii. Stąd wydają się one najlepszym narzędziem do rozwijania nurtu badań zwanego philosophy in silico.

Wiele przykładów zostało omówionych w kontekście języka Python.

48. spotkanie – Koncepcja prawdy w systemach autonomicznych

Kolejne spotkanie grupy odbyło się 10 stycznia 2018. Referat pt. Koncepcja prawdy w systemach autonomicznych wygłosił Andrzej Bielecki. Prelegent przedstawił wyniki swoich badań prowadzonych z Krystianem Jobczykiem nad prawdziwością sądów ocenianych w ramach adekwatności modelu w ujęciu cybernetycznym.

Referat połączył ciekawe obszary rozważań. Po pierwsze przypomniał i podsumował problem prawdy w klasycznym aletejologicznym ujęciu, które zastosowane w teorii systemów ukazuje nowe podejście do relacji sądu i rzeczywistości. Po drugie pokazał, jak podejście cybernetyczne może zanalizować i uściślić problem prawdziwości sądów.

Autorzy mówią o swoim projekcie: Systemy w których prawda jako taka jest analizowana, można podzielić na „zamknięte”, takie jak np. matematyka (istniejące „same dla siebie”) oraz otwarte, czyli takie, które działają w pewnym środowisku, które stanowi ich świat. W systemach otwartych prawda związana jest z poznawaniem świata. Cybernetyka dostarcza narzędzi, które rzucają istotne i nowe światło na procedury poznawania przez systemy autonomiczne (w sensie cybernetycznym), tworzenia modeli świata oraz weryfikację tych modeli przez systemy autonomiczne.

W trakcie wykładu autorzy wykazywali, że prawda w systemie cybernetycznym jest dowiedziona przez adekwatność modelu działającego w kontekście zadania. W ich ujęciu to ten właśnie model – tworzony w bazie wiedzy; korelatorze – staje się nośnikiem prawdy. Kryterium prawdy w systemie cybernetycznym jest jasno wyrażone poprzez różnicę między stanem przewidzianym a stanem osiągniętym przez system. Prawdziwość sądu może zostać zweryfikowana dzięki wykonaniu algorytmu i porównaniu stanów systemu. Autonomiczny system cybernetyczny staje się podmiotem poznawczym, który rozstrzyga problem prawdy dzięki analizie wewnętrznych stanów poznawczych.

Po referacie dyskutowano nad tym, czy cybernetyczne podejście daje wystarczające uzasadnienie dla powstawania sądów. Uczestnicy spotkania zastanawiali się też nad możliwościami autonomicznych systemów do przekształcania baz wiedzy, dochodzenia do prawdy oraz procesami, które takim działaniom towarzyszą.

47. spotkanie – hurtownie danych i eksploracja danych (data warehouse & data mining)

Ostatnie spotkanie w 2017 r. odbyło się 19 grudnia. Wojciech Zasada przedstawił dwie ważne idee współczesnej informatyki: hurtownię danych (data warehouse) i pojęcie eksploracji danych (data mining). Ukazany został kontekst historyczny rozwoju tych pojęć, ze szczególnym zwróceniem uwagi na ich istotę. Zaprezentowana i poddana analizie została Innona definicja hurtowni danych. Poddano dyskusji również pewne epistemologiczne kwestie związane z eksploracją danych (data mining), np. dotyczące poszukiwań modelu dla rzeczywistości opisywanej przez zgromadzone dane.

The last meeting in 2017 was December, 19th. Wojciech Zasada presented two important ideas of computer science: data warehouse and data mining. They were presented in historical development with the focus on the essence of these concepts.

Innon’s definition of warehouse was presented, and was a subject of detailed analysis. Some epistemological aspects of data mining (e.g. searching for a model of described reality) was also discussed.

Data mining by Jason Cale (Flickr)

46. spotkanie – Granice informatyki

W trakcie listopadowego spotkania mieliśmy przyjemność wysłuchać wykładu profesora Adama Olszewskiego pt: Granice informatyki.

Często zastanawiamy się, co ogranicza dziedzinę informatyki oraz jak określić jej miejsce pośród innych nauk. Jest to jeden z ważkich problemów, który wymaga głębszego namysłu. Informatyka jest dyscypliną należącą zarówno do dziedziny nauk matematycznych jak i technicznych. Powodem tego rozbicia jest prawdopodobnie fakt, że przedmioty badań informatyki nie ograniczają się tylko i wyłącznie do jednego uniwersum, lecz przenikają do przestrzeni innych dziedzin. Prelegent przedstawił teorię Stuarta C. Shapiro, według której „informatyka jest nauką przyrodniczą, która bada procedury”. Olszewski przedstawił pięć rodzajów obiektów, które są przedmiotem zainteresowania informatyki: funkcje efektywnie obliczalne, algorytmy, programy komputerowe, realizacje i maszyny. Przemawiający zwrócił uwagę, że powyższe obiekty, mimo wielu powiązań, są rozłączne. Dodatkowo, dwa pierwsze są bytami abstrakcyjnymi, gdy pozostałe są realnymi obiektami naszego świata.

Referat doprowadził do dyskusji, która pokazała, w jaki sposób założenia słuchaczy kształtują ich stanowiska dotyczące informatyki. Mimo dość dobrze sprecyzowanych definicji obiektów informatyki, postrzegamy je często w odmienny sposób. Podział przedstawiony przez Olszewskiego wywołał debatę dotyczącą ontologicznego statusu obiektów informatyki oraz sposobu w jaki się ze sobą współdziałają. Pojawiło się wiele nowych pytań, więc liczymy na to, że wykład profesora będzie niebawem kontynuowany.

During the November meeting we had the pleasure to listen to Professor Adam Olszewski’s lecture entitled: Boundaries of Computer Science.

We often wonder what are limits of Computer Science and how to place it among other fields of sciences. This is one of the valid problems required a deeper reflection. Computer Science is a discipline that belongs both to the field of mathematical and technical sciences. Probably the reason for this division is the fact that CS objects are not limited to a single universe, but rather to the space of other domains. The speaker presented Stuart C. Shapiro’s theory that „computing is a science that examines procedures.” Olszewski presented five types of objects computer science is interested to: computationally efficient functions, algorithms, computer programs, realizations and machines. The speaker pointed out that these objects – despite many connections – are separable. In addition, the first two are abstract entities, while the other are the real objects of our world.

The lecture led to a discussion which showed assumptions which formed positions on computer science of listeners. Despite that, definitions of CS objects are quite well defined, we often see them in a different way. The division presented by Olszewski triggered a debate on the ontological status of CS objects and ways they interact. There are many new questions appeared, so we hope that the lecture will be continued soon.

Zaproszenie do Poznania – Filozofia w informatyce III

Mamy przyjemność poinformować, że już po raz trzeci odbędzie się ogólnopolska konferencja naukowa z cyklu Filozofia w informatyce. Tym razem konferencja odbędzie się w dniach 14-15 grudnia 2017 r.w Instytucie Filozofii Uniwersytetu im. Adama Mickiewicza w Poznaniu. Temat przewodni tegorocznego spotkania to: Informatyczny świat a filozofia.

Mamy przyjemność poinformować, że już po raz trzeci odbędzie się ogólnopolska konferencja naukowa z cyklu Filozofia w informatyce. Tym razem konferencja odbędzie się w dniach 14-15 grudnia 2017 r.w Instytucie Filozofii Uniwersytetu im. Adama Mickiewicza w Poznaniu. Temat przewodni tegorocznego spotkania to: Informatyczny świat a filozofia.

Pierwsza konferencja z tego cyklu odbyła się na Politechnice Warszawskiej (2015) http://calculemus.org/fli/ , druga na Wydziale Filozoficznym Uniwersytetu Papieskiego Jana Pawła II w Krakowie (2016) http://calculemus.org/fi2/ .

Nasze spotkania mają za zadanie scalać różne polskie środowiska zajmujące się refleksją nad informatyką i służyć rozwojowi filozofii informatyki.

Termin nadsyłania zgłoszeń na konferencję: 15 listopada 2017 r. (na adres sekretarza lorayanz@gmail.com ).

Więcej informacji na oficjalnej stronie konferencji: http://calculemus.org/fi3/

45. spotkanie – Pojęcie a znak w świetle systemów informacyjnych

Podczas ostatniego spotkania w r.a. 2016/2017 referat pt. „Pojęcie a znak w świetle systemów informacyjnych” wygłosił prof. André Włodarczyk (Université Ch. de Gaulle – Lille i Paris-Sorbonne).

(Autoreferat)

Wielu podstawowych zagadnień semiozy nie da się wyjaśnić ani przy pomocy dwudzielnej teorii znaku (forma:treść) ani żadnej z odmian teorii trójdzielnej (forma:treść:świat). Ponadto filozofowie treść (czyli znaczenie) traktują zamiennie: albo tylko intensjonalnie albo wyłącznie ekstensjonalnie. W oparciu o powstałą na gruncie informatyki dziedzinę badań zwaną drążeniem danych (data mining), a zwłaszcza o najnowsze podejście symboliczne (tj. od strony logiki), w przeciwstawieniu do analiz danych cyfrowych (tj. od strony statystyki), wiedzę o świecie można pozyskiwać stosując metody należące do nauk ścisłych. Jako że centralnym zagadnieniem wszelkiej wiedzy jest pojęcie, warto zapożyczyć jego definicję z teorii Analizy Pojęć Formalnych (Formal Concept Analysis – FCA), a skoro na pojęcia formalne składają się równocześnie tak ekstensje jak i intensje, nowa teoria semiozy zyskać może nie tylko na formalnej spójności, ale także na bardziej szczegółowej analizie.

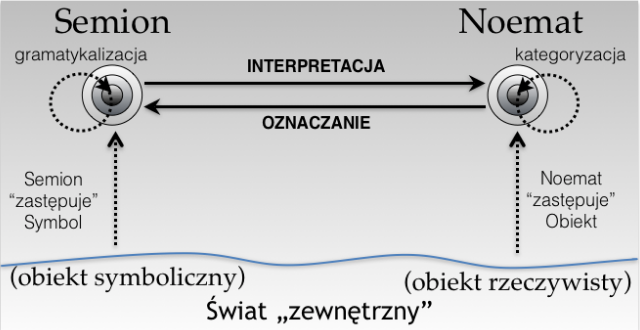

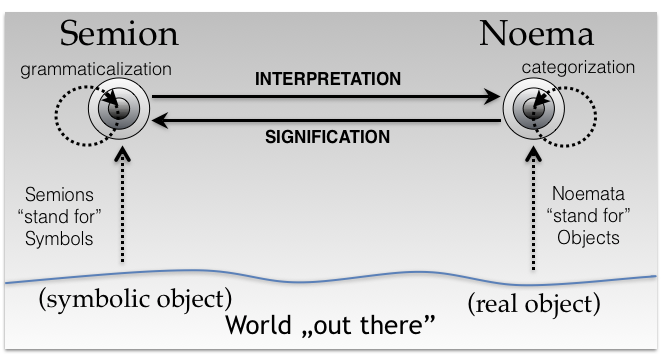

Z przeprowadzonych doświadczeń (interaktywnych badań nad wyrażeniami językowymi) przy użyciu narzędzi do analizy danych nasuwa się następujący wniosek: zarówno znaki, ikony jak i wskaźniki są w pierwszym rzędzie sygnałami i – jako takie – winny być traktowane tak samo, jak wszystkie inne obiekty (szerzej: rzeczy). Dopiero przyporządkowanie pojęć semiotycznych (semionów) pojęciom nie będącym pojęciami semiotycznymi (noematom) pozwala na mówienie o znaczeniu. Zatem traktując znaki wszelkiego rodzaju jako byty same w sobie, można rozpatrywać nie tylko obiekty i relacje, lecz również wszelkie „nośniki” treści semiotycznych i ich wzajemne powiązania z tego samego punktu widzenia.

Inaczej mówiąc: tak “rzeczywiste” przedmioty jak i przedmioty “zastępcze” (sygnały) mają w naszych umysłach przyporządkowania pojęciowe (ontologiczne). Ponadto, zachodzące między jednymi a drugimi związki są czysto arbitralne. To właśnie te związki stanowią treści semantyczne, nie zaś aksjomaty logiczne, które sugerują istnienie bezpośrednich związków znaków ze światem zewnętrznym. A więc “treści semantyczne” są wynikiem niekonforemnych odwzorowań semionów w noematy, przy czym budowa tak semionów jak i noematów wymaga jakiegoś wspólnego kodu wewnętrznego (systemowego) w kontraście do poglądu, jakoby wszystkie procesy naszej myśli zachodzić miały w języku naturalnym. Warto także podkreślić, że proponowana teoria semiozy (w porównaniu z teoriami klasycznymi) zapewnia znakom (będącym składnikami semionów) więcej autonomii wobec pojęć poznawczych (noematów) oraz wskazuje na potrzebę rozwiązania niebłahego problemu, a mianowicie względnego (cząstkowego, często niewłaściwego, a nawet zupełnie błędnego) stosunku semantyki od ontologii.

Logika a pozyskiwanie wiedzy

Dla potrzeb eksploracji danych w informatyce powstaje coraz więcej logik, których punktem wyjścia są m. in.: potrzeba przedstawienia informacji, redukcja wiedzy pewnej, przybliżenie wiedzy niepewnej oraz ewaluacja uzyskanych wyników w trybie drążenia danych. Do tego rodzaju badań należą takie logiki, jak: (a) logika kontekstowa (Contextual Logic) wywodząca się z analizy pojęć formalnych (Formal Concept Analysis), (b) logika decyzyjna (Decision Logic) wywodząca się z teorii zbiorów przybliżonych (Rough Set Theory) i (c) logika rozmyta (Fuzzy Logic). Ponadto, pewne nadzieje na praktyczne zastosowania można żywić wobec logiki przepływu rozproszonej informacji (Distributed Information Flow Logic), która wyrosła na gruncie badań nad sekwentami stanowiącymi podwaliny tzw. semantyki sytuacyjnej (Situation Semantics).

Pojęcia (formalne) a znaki

Pojęcie formalne – to para ekstensji i intensji otrzymana w wyniku działania dwoistej funkcji przyporządkowania atrybutów obiektom formalnym i na odwrót (wg. definicji formalnej Rudolfa Willego – 1982 r.). W Analizie pojęć formalnych (FCA – Formal Concept Analysis) przedmioty (świata rzeczywistego i fikcji) są traktowane jak obiekty formalne. Właściwie termin obiekt formalny, stanowiąc ekstensję pojęć formalnych, jest symbolicznym “odwzorowaniem” przedmiotu (szerzej: rzeczy), ponieważ dla istot obdarzonych systemami kognitywnymi rzeczy mają jakby dwa “wcielenia”: zewnętrzne (istniejące w otoczeniu) oraz wewnętrzne (przedstawione w umyśle). Powyższe nie wyklucza ani tego, że owo „istnienie w otoczeniu” może być nieznane (nienazwane), ani też tego, że owo „przedstawienie w umyśle” może być tylko wyobrażone (mniemane). W każdym przypadku mamy do czynienia z ekstensją pojęć formalnych.

W dodatku spośród rzeczy wyróżnić jeszcze należy znaki, których obiekty formalne są ekstensjami pojęć formalnych. Tego rodzaju pojęcia proponuję nazwać semionami. Zatem należy rozgraniczyć pomiędzy

(1) pojęciami formalnymi np. języka naturalnego, w skład ekstensji których wchodzą znaki jako obiekty formalne. Na przykład “kobieta” w:

{{“kobieta”}, {część mowy: rzeczownik, rodzaj: żeński}}

a (2) pojęciami formalnymi kodu wewnętrznego (niekoniecznie mającymi wykładniki językowe), w skład intensji których wchodzą obiekty formalne odnoszące się tak do świata rzeczywistego, jak na przykład [kobieta] w:

{{[kobieta]}, {byt: ludzki, płeć: żeńska}}

jak i do świata fikcji, np. [pegaz] w:

{{[pegaz]}, {byt: zwierzę mityczne, rodzaj: skrzydlaty koń}}).

Schemat stosunku znak-pojęcie (wg A. Włodarczyka)

W przypadku znaków istotą rzeczy jako meta-obiektów (czyli obiektów formalnych) jest jednocześnie „zastępowanie” innych rzeczy, co nastąpić może wyłącznie w umyśle (wewnątrz systemu kognitywnego), ponieważ – na mocy konwencji – wymaga ono funkcji interpretacji, tj. przyporządkowania semionów noemom. Jest to wyraźne odejście od semiotycznego trójkąta Peirce’a, ponieważ (1°) występują tu dwa pojęcia (a nie jedno) wobec symbolu i świata oraz (2°) z uwagi na to, że pojęcia zdefiniowane jako pary formalne {{ekstensja},{intensja}} są składnikami przestrzeni wiedzy. W konsekwencji powyższych rozważań klasyczne pojęcia „formy” i „treści” są doprecyzowane, ponieważ każde z nich wchodzi w skład ekstensji pojęcia formalnego, a więc dwoistej pary {ekstensja, intensja}, a to znaczy, że ani “forma” nie ogranicza się do ekstensji ani też „treść” do intensji, przy czym „forma” znaku wymaga w pierwszym rzędzie wiedzy semiotycznej, podczas gdy jego “treść” poprzez interpretację semantyczną – wymaga wiedzy ontologicznej ugruntowanej w pojęciach formalnych dotyczących rzeczy. Nadmieńmy, że przyporządkowanie tych dwóch rodzajów pojęć ma charakter umowny (intersubiektywny), zasadza się na schematach (walencjach słownych), a więc jest słabo rekurencyjne. Przyczyną tego faktu jest to, że zarówno wszelka wiedza o otaczającym nas świecie jak i komunikacja międzyludzka są w naszych umysłach schematyczne (modularne), sieciowo rozproszone. Zatem powstająca nowa teoria znaku nabiera charakteru operacyjnego, czego brakowało semiologicznym teoriom F. de Saussure’a i Ch. Peirce’a.

Concepts and Sign in the light of Information Systems

The mathematical definition of a concept, known as formal concept, is a dual pair of extension and intension within a given context of assignments of features (“intents”) to objects (“extents”). This definition, given by R. Wille (1982), greatly inspired the data-mining community. From a linguistic point of view, applying this definition to cognitive domains makes it possible, first of all, to treat symbols in the same way as “real world” objects; i.e.: as both symbolic objects and real objects considered as extents of formal concepts within their own contexts. In classic semiotics, concepts are either “signified” parts of signs which are “inseparable” from their “signifier” parts (F. de Saussure) or “interpretants” (kind of link or function) of symbols w.r.t. objects (Ch. S. Peirce). However, within the data-mining community, studies of signs as objects are rare. The formalization of Peircean semiotics is the work of U. Priss and it should be seen as an exception. Nevertheless, the resulting theory is a reconstruction of the original one rather than a recasting proposal.

Sign-Concept Relationship Schema (by André Wlodarczyk)

In the present approach, sign-objects are internalized as formal objects of the formal concepts called Semions and real objects (things) are internalized as formal objects of the formal concepts called Noema. Note that, in the examples below, while “Mädchen” is a German word, [girl] represents the formal object of a Thing.

Tentative example of a (German) Semion:

{{„Mädchen”}, {Part-of-Speech: noun, Gender: neuter}}

Tentative example of an (universal) Noema:

{{[girl]}, {Entity: human, Sex: female}}

Clearly, the meaning of an expression is the interpretation function from Semions to Noemas, while signification is the expression being the range of an inverse interpretation. Consequently, the meaning of natural language expressions is not the function between symbols and their representations but the one between symbolic concepts and cognitive concepts.

It also turns out that, in the Saussurian theory of sign, the “signifier” is “extent” and the “signified” is “intent” either of Semion or of Noema, on the one hand, and that the Peircean “interpretant” on the other hand is actually a function, not a “concept”. In other settings of the Peircean theory where the “interpretant” is a “concept”, it must be split into two.

As a concluding remark, it is important to note that in this completely new setting, man thinks in an internal conceptual code rather than in a natural language.